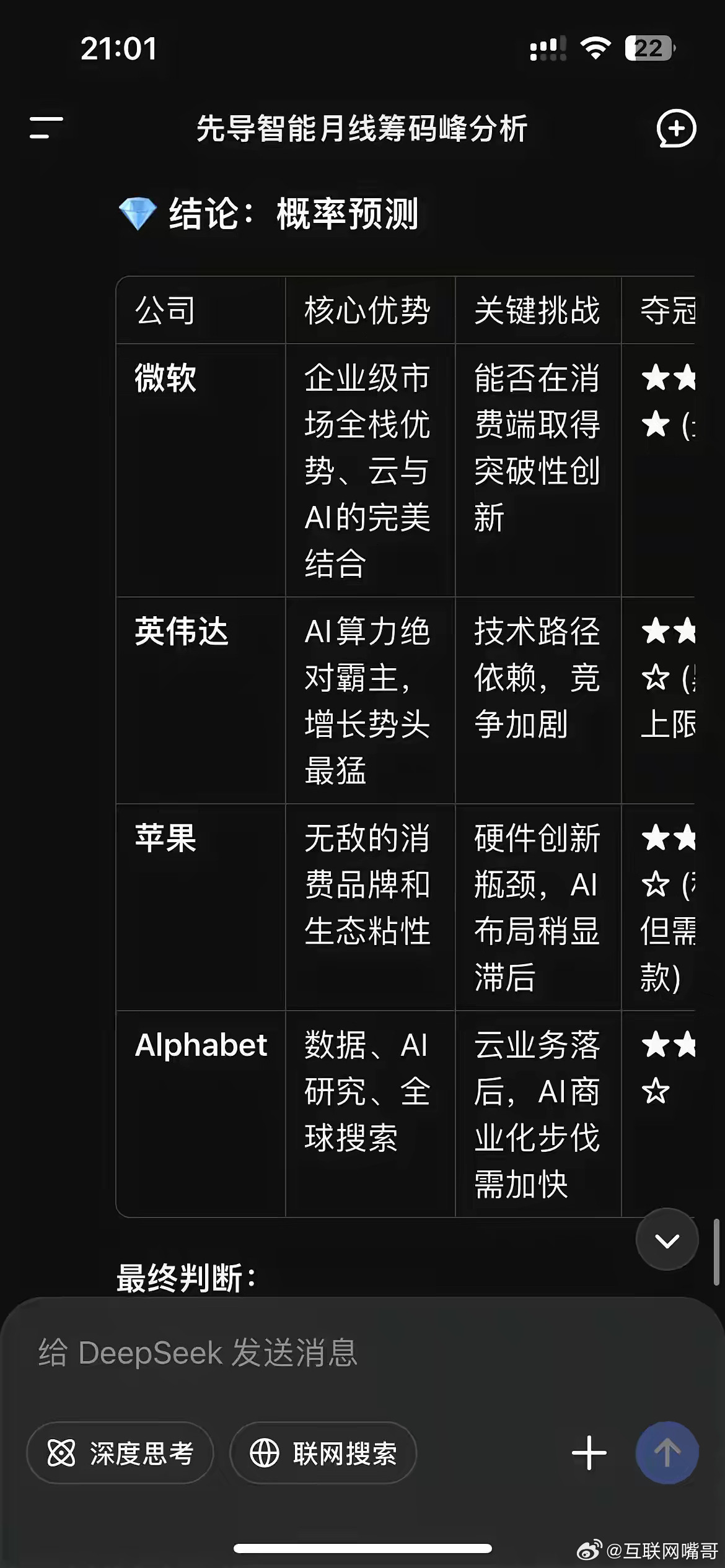

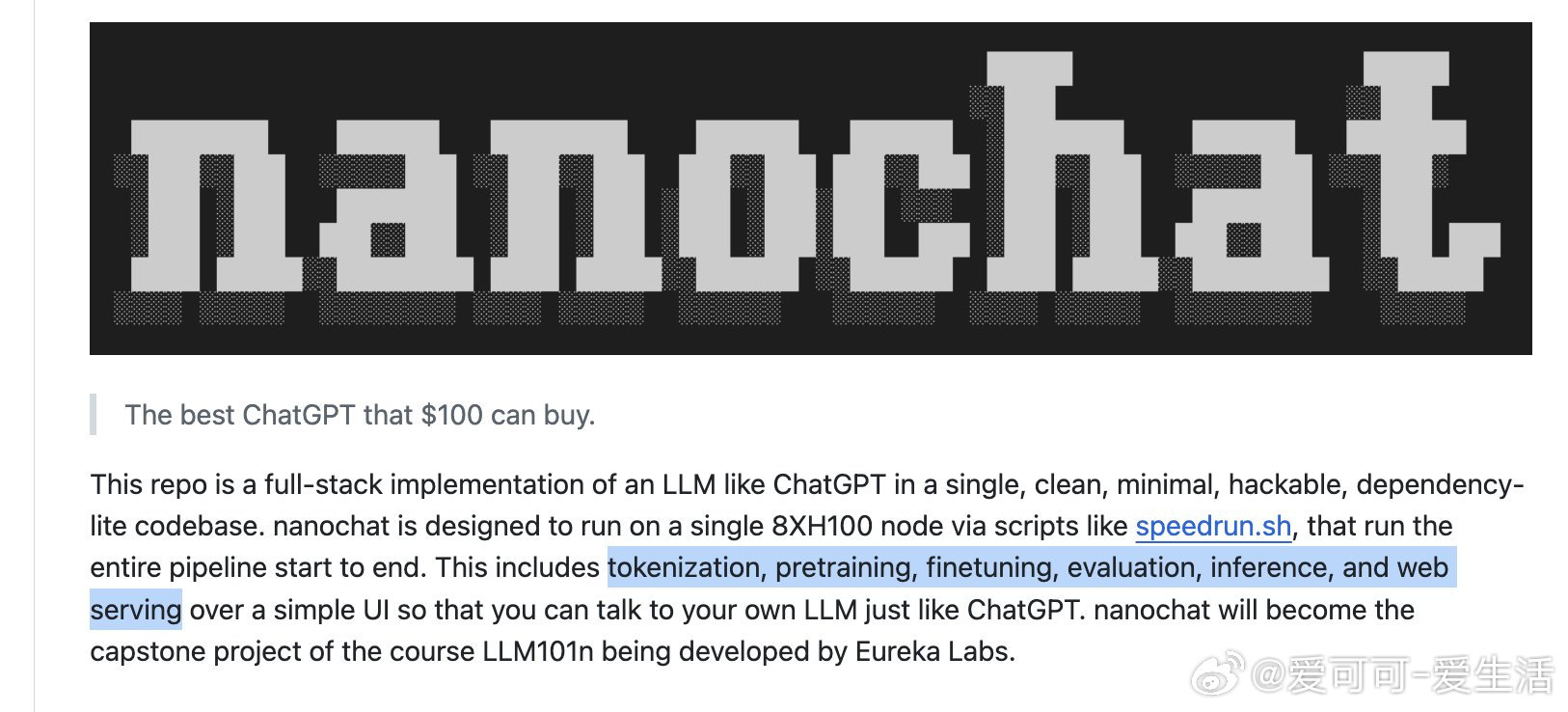

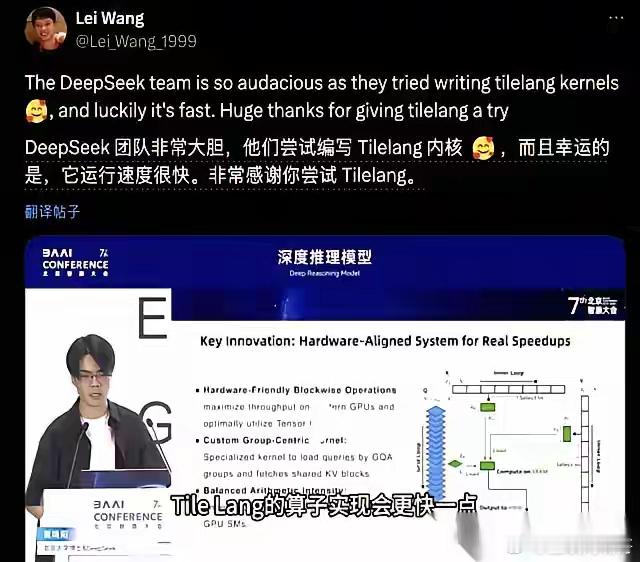

DeepSeek创始人梁文峰再次语出惊人!他说:“我们经常说中国AI和美国有一两年差距,但真实的差距是原创和模仿之差。如果这个不改变,中国永远只能是追随者,所以有些探索也是逃不掉的。” 大家怎么看,一起评论区唠唠! 梁文峰这话听着扎心,但确实戳到了行业的痛点。过去几年,国内大模型越做越多,名字换了一茬又一茬,可底层逻辑还是那套Transformer,核心框架还是别人的。 而美国靠着芯片、框架和生态一体化,建起了别人绕不开的技术闭环,GPU、CUDA、Transformer,从算力到算法,全都卡在他们手里。 咱们的问题不是没进步,而是陷在“跟跑”模式里太久,人家OpenAI砸40%的预算搞底层创新,我们这边平均8%就算多。 大家都想快出成果,可模仿的红利早就被榨干,去年美国一收紧AI框架出口,国内一批靠开源做二次开发的公司立刻瘫痪。 你靠别人家的地基盖房,总有一天房塌了还得求那人修。 DeepSeek算是走出第一步的团队,2024年他们干脆停掉了“堆参数”那一套,改攻稀疏注意力机制。 团队从算子结构入手,用TileLang语言重写底层逻辑,反复推翻十几版方案,最终搞出了TileLang和CUDA双栈算子,华为昇腾团队拿到代码当天就能跑,这意味着国产芯片终于能在AI框架上自由呼吸。 而新模型DeepSeekSparseAttention上线后,长文本处理效率翻倍,这才算是真正摸到了原创的门槛。 更聪明的是,他们没去和GPT比参数,而是反过来做“软件定义算力”,算力不够?那就从算法上挤出空间,把低算力芯片调教到最优状态。 对企业来说,这才是真香:便宜、省电、不被卡脖子。 这背后的思路变了,从“跟技术”到“解结构”,不是抄别人模型,而是拆明白为什么有效、怎么优化。 梁文峰说,他们的核心原则是——技术不为炫技,只为真问题,这句话听着朴实,其实是国内AI行业的拐点。 而DeepSeek的这次转弯,不只是技术路线的改变,更像是整个行业意识的觉醒,梁文峰干脆把研发目标定得更直接:从问题出发,用产业去倒逼科研。 他们在医疗、法律、制造、农业这些领域试点,让模型去解决真问题,而不是做“实验室里的炫技”,医疗团队用他们的算法识别罕见病基因突变,准确率提高了6个百分点;法律领域用长文本模型审合同,审查时间从8小时压到20分钟。 这些成果都不是靠追参数出来的,而是靠“问题—算法—算子—硬件”四层联动打磨出来的。 这套方法比闭门造车更有生命力,DeepSeek把核心技术彻底开源,权重、算子、框架全放出去,让全国开发者都能在这套架构上加砖添瓦。 有人基于TileLang调试效率优化,有人把CUDA版本迁到国产芯片上,这种“众包式研发”让创新变成了全民工程,更妙的是,开源还反过来带火了国产硬件生态。 企业要跑DeepSeek模型,自然得配昇腾、寒武纪这些芯片,硬件厂商因此也有了数据回流和优化的空间,整个生态的正反馈终于启动了。 不过原创的路注定不好走,DeepSeek两年烧了4亿多,其中三分之二投在基础研究上,梁文峰说,这笔钱花得“肉疼但值得”,因为模仿省钱但没未来。 现在政策也在往这个方向倾斜,科技部AI专项基金把基础研究支持比例提到60%,各大公司开始建底层架构实验室。 中国AI终于意识到,只有肯花时间搞“慢活”,才能摆脱“快抄”的恶性循环。 当然,风险也摆在眼前。 原创周期长、教育体系供给慢、国际专利难获承认、生态迁移痛,这些都是必须啃的硬骨头,但只要方向对了,就算走得慢,也在爬坡。 而DeepSeek的目标早已不是追GPT的脚步,而是定义下一个能被世界引用的新范式,梁文峰说得明白:追随者看别人跑多快,造路者关心地平线在哪。 原创这件事,逃不掉,也不该逃,只有把“逃不掉的探索”变成习惯,中国AI才真正算站起来。 对此,大家有什么想说的呢?欢迎在评论区踊跃留言!麻烦看官老爷们阅读后点赞关注,谢谢! (个人观点,理性观看)

![最火ai排名,你平常用哪个[思考]](http://image.uczzd.cn/13567813052405002715.jpg?id=0)