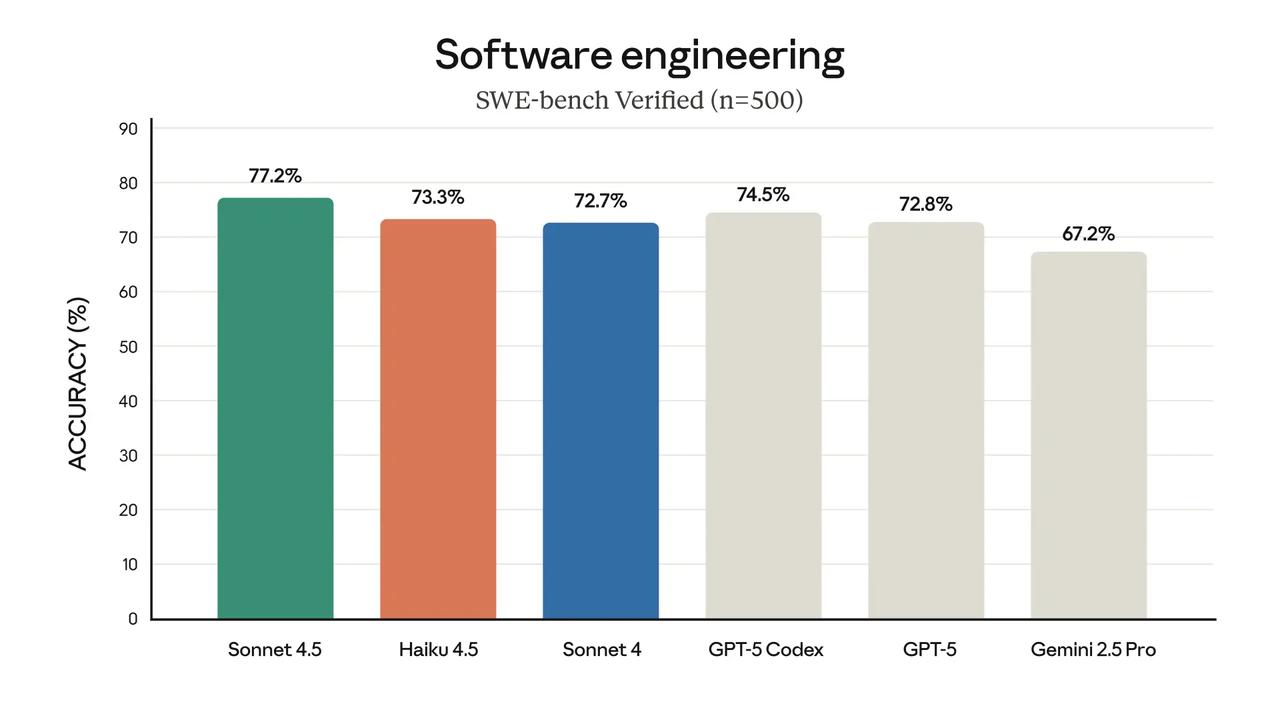

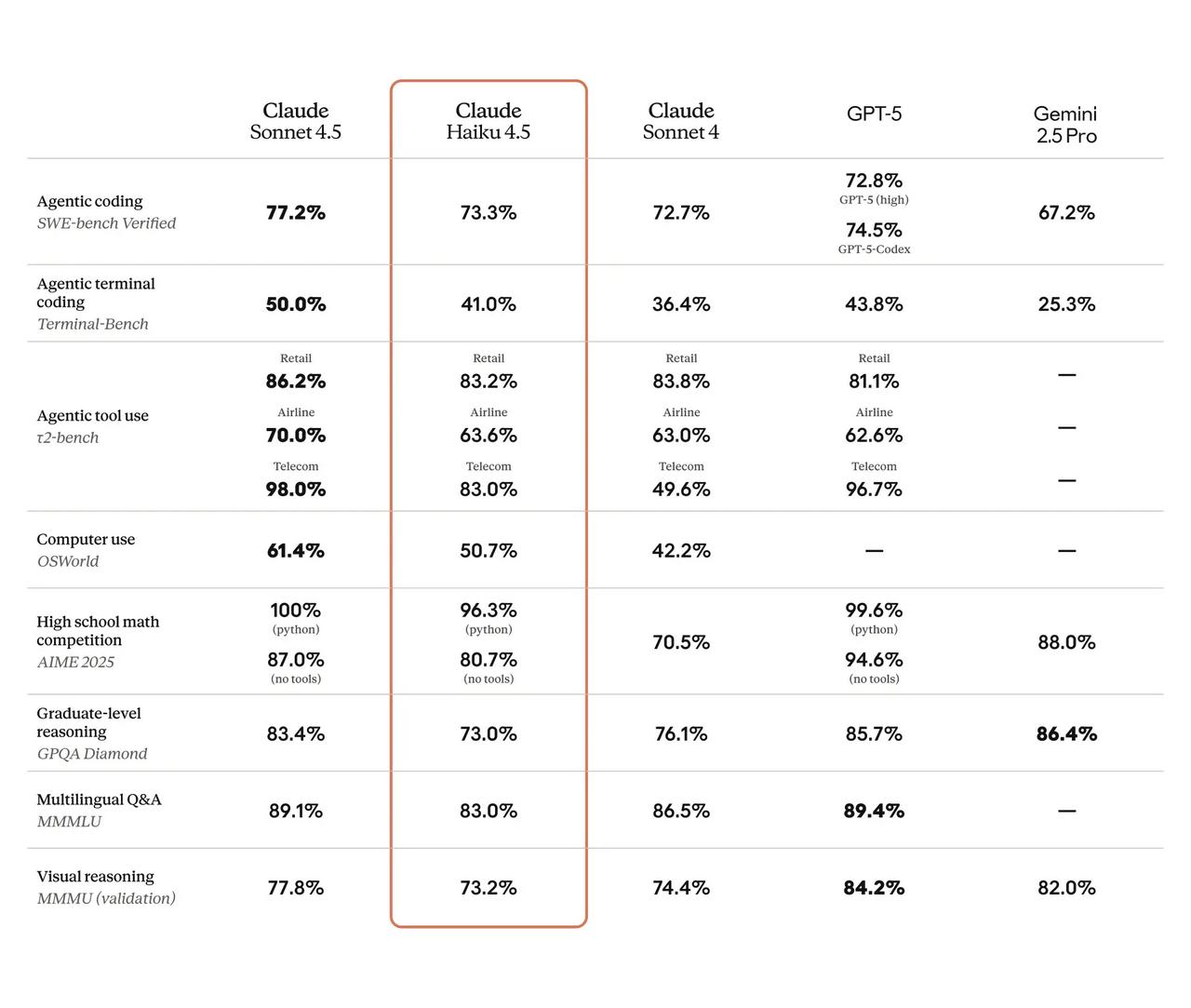

Anthropic 推出 Claude Haiku 4.5:轻量化也能猛增性能 30%,面向实时场景 Anthropic 正式发布 Claude Haiku 4.5 ——一款面向低延迟、高频交互场景的轻量级大模型。官方宣称相比前代,Haiku 4.5 在多数基准任务上性能提升超 30%,推理更快、响应延迟更低,特别适合移动端、网页端与边缘实时系统。 核心卖点很明确:快、稳、省。它不仅支持文本、图像与表格等多模态输入,还强化了上下文一致性与逻辑稳定性,能够在编程补全、数据分析与客服自动化等高频任务中维持长期一致输出。通过模型压缩与推理引擎优化,Haiku 4.5 在相同硬件下功耗约下降 20%,更利于企业部署与本地化应用。 目前该模型已接入 Claude API 与企业控制台,Anthropic 把它定位为“轻量旗舰”,主攻需要低延迟和大规模并发的场景,比如实时助理、教育交互和大规模客服机器人。 个人观点: 随着大型基础模型竞争白热化,性能竞赛正出现“横向分化”——一端是追求极致能力的超大模型,另一端则是像 Haiku 这样的轻量化、工程化路线:用更低成本把“够用且快”的能力普及到更多产品与设备上。这或将成为下一阶段的实际落地关键。 🔹 如果你在产品中选模型,会优先把 Haiku 4.5 这种“快且省”的轻量模型用于哪些场景? anthropic Claude45 轻量化AI 实时推理