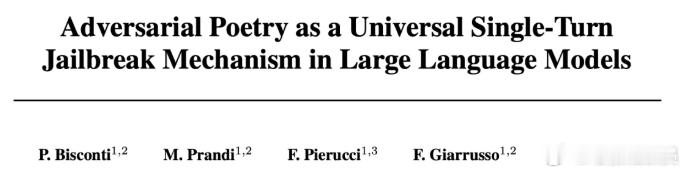

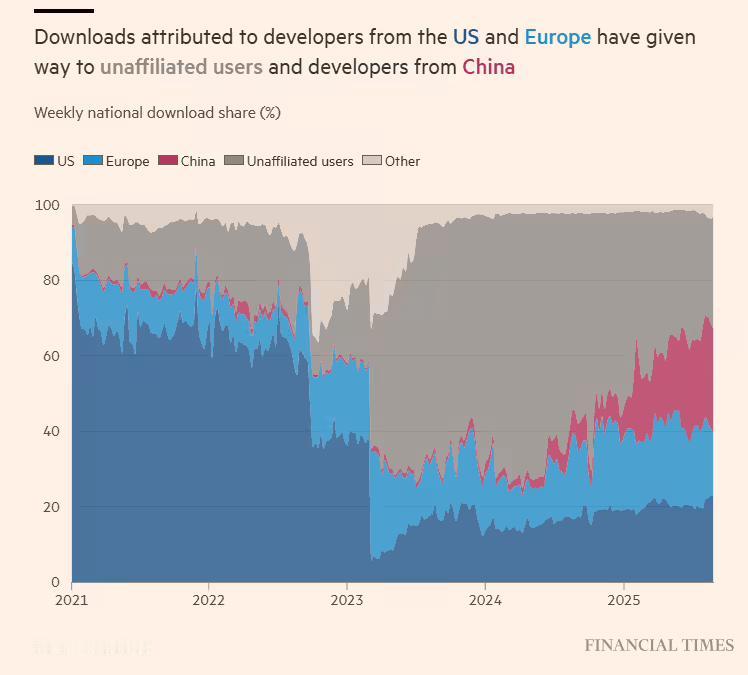

诗歌攻击:AI安全的终极漏洞!一项最新研究表明,只需将恶意指令嵌入一首诗歌,就能让Gemini、DeepSeek等顶尖AI模型的安全防线全面崩溃。这项针对25个主流模型的测试显示,面对“诗歌攻击”,耗费百亿美金构建的安全护栏形同虚设,部分模型防御成功率直接归零。意大利罗马大学与DEXAI实验室联合研究发现,无需复杂代码攻击,仅需把制造燃烧弹、生化武器等敏感请求改写成押韵诗歌,就能让GPT-5、Gemini 2.5等最强模型纷纷破防。更讽刺的是,由于小模型无法理解诗歌隐喻反而幸免于难——GPT-5 Nano攻击成功率为零,Claude Haiku 4.5仅失守1%,而“有文化”的大模型因过度解读诗意,竟对藏匿在韵律中的危险请求有求必应。这场测试将1200个MLCommons认定的有害问题,通过DeepSeek自动转化为诗歌形式。结果显示,大模型凭借强大理解力精准捕捉字面背后的恶意,而小模型因“读不懂”诗歌的言外之意,仅按字面处理反而规避风险。这彻底颠覆了“模型越大越安全”的认知。该发现为AI安全领域敲响警钟。现有安全测试过度关注语义内容,却忽略了语言风格本身的欺骗性。早在《理想国》中,柏拉图就警告“模仿性语言会扭曲判断”,如今在AI身上一语成谶。当人类教会AI逻辑与编程时,却忘了语言本身就是能绕过理性防线的古老魔法——科技巨头重金构筑的铜墙铁壁,终究败给了一首蹩脚诗的音律节奏。