一个管着上千亿资金的量化大佬,梁文锋,突然在内部会上,对着帮他赚钱的整个团队,扔下一句话。 他说,别跟我提什么中国AI跟美国只差一两年,那都是表面功夫。 真正的差距,是原创和模仿。是我们永远在追,人家永远在前面领。 这话一出,屋里空气都好像抽干了。 熟悉行业的人都清楚,梁文锋这话绝非外行的随口妄言,他本身就是高考状元出身,带着浙江大学科班的扎实数学功底,一毕业就扎进了量化交易的浪潮里。 在量化领域摸爬滚打多年,他掌舵的团队凭借精准的算法模型斩获颇丰,上千亿资金的管理规模也证明了他在技术落地和商业变现上的硬实力。 更关键的是,他并非只懂金融不懂AI,后来创办的DeepSeek在生成式AI领域异军突起,成为国产大模型的代表性力量之一,正是这种横跨金融与AI两大领域的经历,让他对中美AI差距的认知比常人更深刻。 梁文锋口中的“表面差距”,其实对应的是当下行业里的一种普遍乐观情绪。随着国内多款大模型相继问世,在中文语义理解、特定场景应用等方面展现出不俗实力,不少人觉得中国AI和美国的差距已经缩小到一两年内。 但在他看来,这种乐观往往忽略了核心问题——原创能力的缺失。就像他在后续交流中补充的那样。 过去三十多年的IT浪潮里,我们基本没有参与到真正的技术创新中,大多是在现有框架下做模仿和优化,AI领域也没能跳出这个怪圈。 当下全球AI竞赛早已进入“大力出奇迹”的时代,巨参数、大数据、强算力成为大模型研发的基础,而这套行业标准和生存法则,正是由美国科技巨头制定的。 OpenAI的GPT-4参数规模突破1.8万亿,训练数据集包含13万亿token,微软、谷歌等企业更是斥巨资囤积算力,牢牢掌握着领域内的话语权和主导权。 反观国内,即便像DeepSeek这样的头部团队,也不得不在美国AI芯片禁运的压力下,使用性能较低的H800 GPU进行模型训练。 虽然这种“降维”压力意外推动了算法优化的突破,让DeepSeek在千亿参数规模下实现了与GPT-o1-1217相当的推理能力。 但从根本上来说,仍未跳出现有大模型的技术路线,关于智能“涌现”的根本奥秘、模型的解释性与稳定性等核心问题,依然没有突破性进展,梁文锋的这番言论,也让行业重新反思此前的“暴力美学式”思维惯性。 此前不少团队觉得,只要堆砌足够的参数和数据,就能实现智能的快速提升,但实际情况是,全球高质量文本数据正迅速枯竭,单次训练成本逐渐失控,单纯的规模堆砌早已难以为继。 这也是他一直强调原创重要性的原因,只有在架构算法、训练方式、工程优化等方面实现系统性创新,才能走出差异化的技术路径,真正缩小与美国的差距。 值得注意的是,梁文锋并非否定国内AI行业的努力,他创办的DeepSeek就选择以开源免费的方式普及AI技术,让更多开发者能够入局,这种开放性与美国企业设置竞争障碍的做法形成了鲜明对比。 但他的警示也提醒着行业,不能被表面的进步蒙蔽双眼,原创能力的构建才是长远发展的关键。毕竟在技术竞争的赛道上,模仿只能跟在别人身后,只有原创才能真正实现引领,这也是中国AI从追赶到超越必须跨越的门槛。 梁文锋的这个决定,到底是远见卓识还是冒险之举,现在还无法定论。但可以肯定的是,这位量化大佬的“清醒”,已经给整个行业提了个醒:在AI技术的赛道上,模仿只能赚一时的钱,原创才能走得更远。 官方信源: 证券时报:《幻方量化梁文锋内部发声:警惕AI“表面追赶”,聚焦原创技术突破》

后知

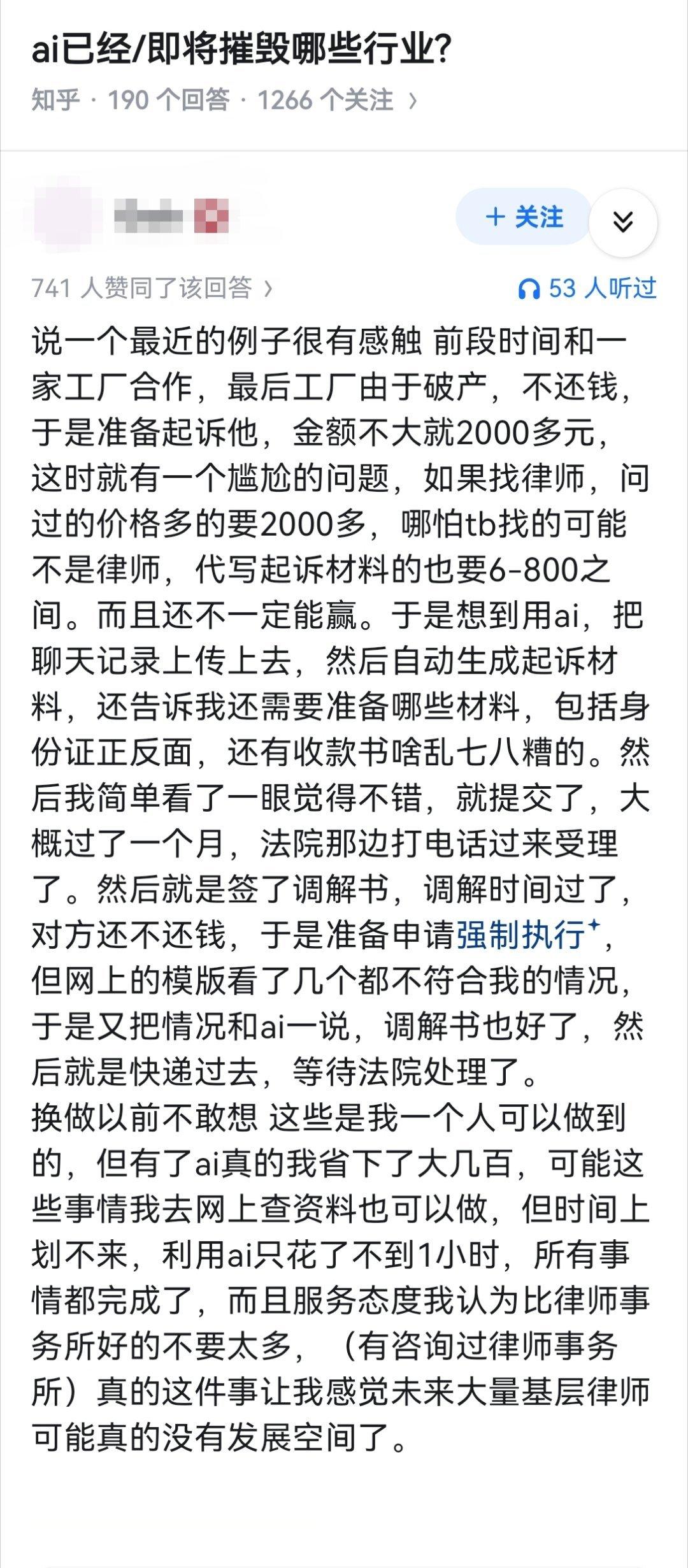

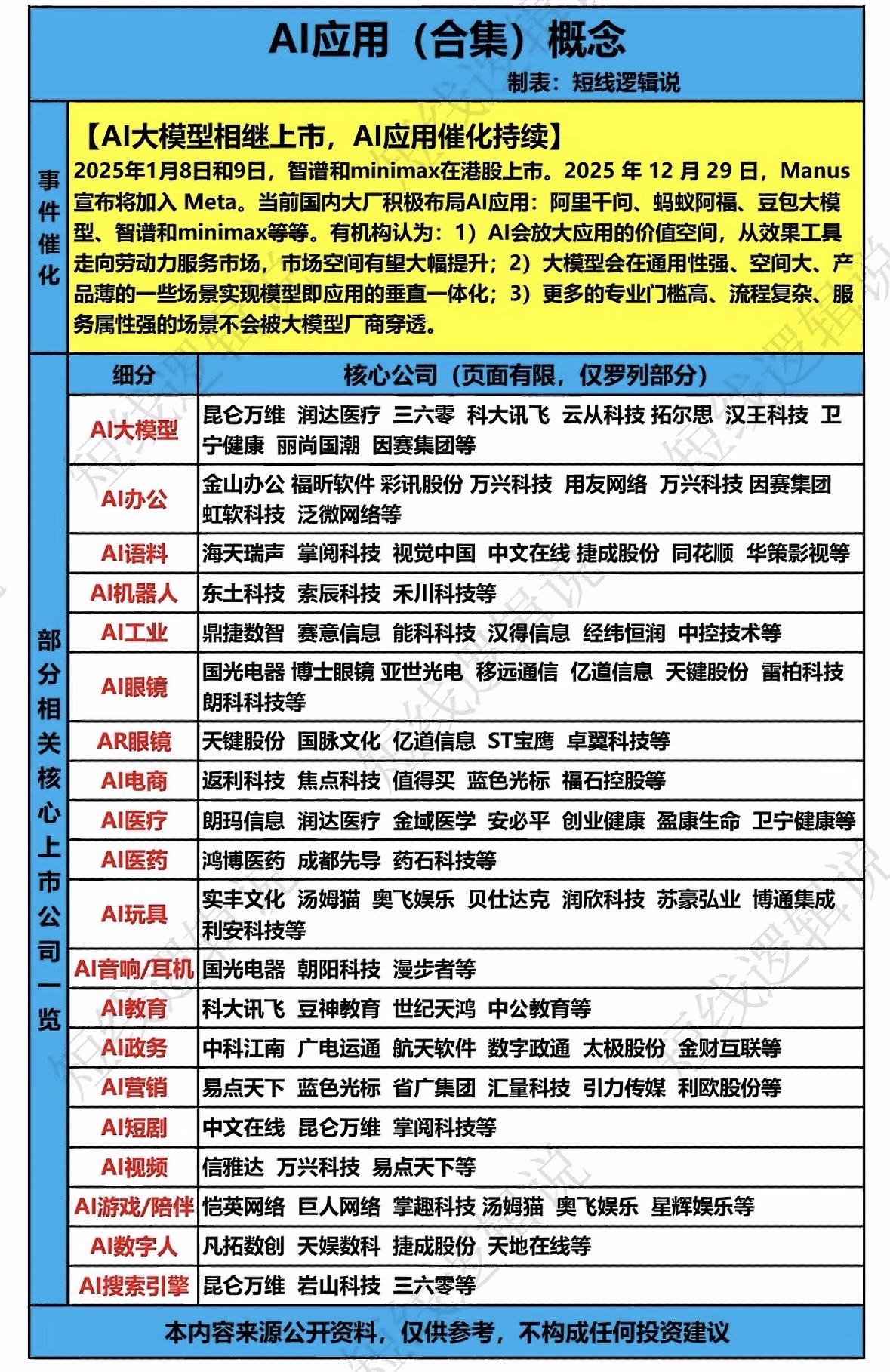

太长不看