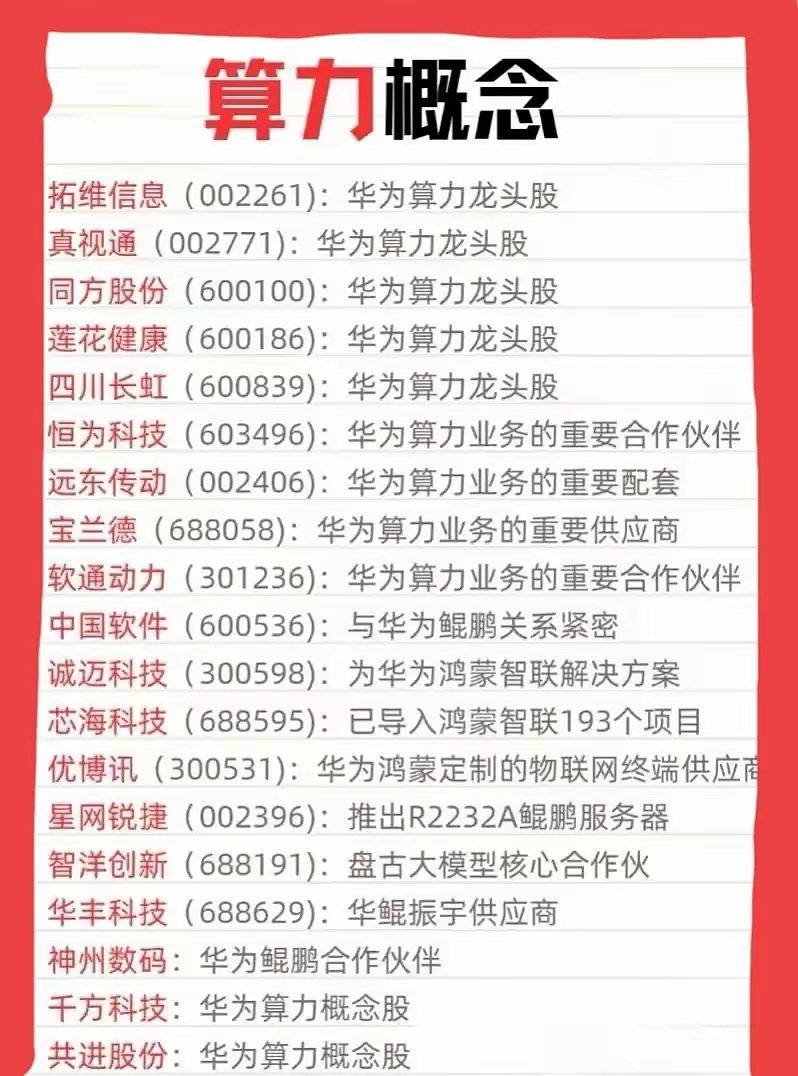

“中美差距究竟有多大?”DeepSeek创始人梁文峰再次语出惊人!他说:“我们经常说中国AI和美国有一两年差距,但真实的差距是原创和模仿之差。如果这个不改变,中国永远只能是追随者,所以有些探索也是逃不掉的。” 先看美国,他们在 AI 这块早把 “垄断” 玩到极致了。就说搞出 ChatGPT 的 OpenAI,弄出 GPT 系列模型后,直接把核心技术藏得严严实实,走 “闭源” 路线 — 只给你用现成的功能,不给你看里面的门道。还搞了个 “API 生态”,全球几十万开发者想用上 GPT 的技术,都得按 OpenAI 的规矩来,相当于把 AI 行业的 “钥匙” 揣自己兜里,别人想干活就得听他们的。 算力上美国更狠,早好几年就砸几百亿建超算中心,算力强得没边;英伟达的 H100 显卡是搞 AI 训练的 “硬通货”,美国说不让卖给中国超算中心,就直接断货,明摆着卡咱们脖子。 更关键的是,连 AI 规则美国都想自己定 — 他们推的《人工智能风险管理框架》,看着讲 “风险”,其实全顺着自己的技术优势来,怎么方便创新就怎么定,对数据隐私要求松得很,说白了就是想把全球 AI 都绑在他们的轨道上。 再看中国,走的路完全不一样。梁文峰的 DeepSeek 就没跟着闭源,反而把基础模型 “开源” 了 — 技术全公开,谁都能拿来用、拿来改、一起完善。 现在 GitHub 上,基于它的衍生项目超 800 个:帮律师查法条的 LawSeek,让律师找案例快了好几倍;辅助医生看 CT 片的 MedSeek,能早发现病灶,省了医生不少事。这么多人一起琢磨,技术迭代速度比以前快了 30% 还多,效率根本不是以前能比的。 而且咱们的 AI 特别 “接地气”。百度的文心大模型,对中文理解透得很 — 古文典故、网络热词、甚至方言梗,都能精准 get 到;华为的盘古大模型专门针对工厂优化,帮生产线调参数、预判机器故障,比传统工程师效率高好几倍。 美国的 GPT-4 虽然能处理十几种语言,但论对中文语境的理解,咱们的模型真能甩它一条街,这可不是小优势,是咱们在 AI “语言地盘” 上稳稳站住了脚。 美国没少给咱们使坏,最狠的就是芯片禁令。 但咱们没坐以待毙,不少企业自己闯新路子。比如小鹏汽车,搞自动驾驶训练时没盯着 H100,反而琢磨出 “分布式算法”— 把复杂任务拆成小块,用普通 GPU 集群就能算,效果一点不比 H100 差。 现在这套技术不仅让小鹏自动驾驶反应更快,还被其他企业学了去,相当于在美国卡脖子时,咱们自己闯出了条算力新路。 现在咱们的 AI 企业还在试更牛的玩法,DeepSeek 的模式就很典型:基础模型开源,大家一起把技术做透;但在法律、医疗这些细分领域,把核心算法申请专利,既让技术快速扩散,又守住自己的竞争力。 粤港澳大湾区的企业也这么干:腾讯把微信处理社交数据的经验,用到大模型的情感交互上,现在 AI 聊天能懂喜怒哀乐,不再冷冰冰;大疆把无人机飞控技术挪到工业机器人上,让机器人干活又快又稳,误差比头发丝还细。 说到底,中美 AI 的差距,真不是 “一两年” 那么简单,是能不能自己搞原创的本质区别。美国靠早期积累,把 “闭源 + 垄断 + 定规则” 的路走通了,占了先发优势; 但咱们也有机会 — 有全球最大的市场、最多的应用场景、最接地气的需求,还有不怕难的闯劲。只要咱们把 “场景 - 数据 - 算法” 串起来,从 “抄作业” 变成 “自己出题自己做”,就不用一直当 “追随者”。 梁文峰的话听着扎心,其实是给行业打了针 “清醒剂”:该闯的就得硬闯,该做的原创就得死磕。现在不少企业已经在这么干了,相信用不了多久,中国 AI 肯定能从 “跟跑” 变成 “领跑” 这可不是空想。